損傷変数が上限値を超過

概要

先生! 今日は損傷変数が上限値を超過の話なんですよね? どんなものなんですか?

理論と物理

損傷変数の物理的意味と上限値

「損傷変数が上限値を超過」というエラーが出ました。そもそも損傷変数って何を表しているんですか?

損傷変数Dは、材料の有効な負担面積の減少を表す無次元の内部状態変数です。例えば、初期状態ではD=0で、完全に破断した状態ではD=1と定義されます。この時、有効応力σ_effは公称応力σと

上限値はなぜ1じゃないんですか? 破断がD=1なら、それを上限にすればいいのでは?

数値計算上の安定性が主な理由です。Dが0.99など1に極めて近い値になると、有効応力が100倍に増幅され、剛性マトリクスが特異に近づき、ソルバーが収束しなくなります。そのため、多くの商用コードでは破断をD=1と定義しながらも、計算上の破棄基準(element deletion criterion)をD_crit=0.99や0.999などに設定しています。Abaqusのダメージエボリューション定義では、破棄時の損傷変数D_maxをデフォルトで0.99としている例があります。

損傷変数が1を超える可能性は物理的にないはずですが、なぜ「超過」するエラーが発生するのでしょうか?

良い着眼点です。物理的には0から1の範囲ですが、数値積分の過程で生じる誤差が原因です。特に陽解法(Explicit)で大きな増分ステップを使う場合、あるステップでD=0.8だったものが、次のステップの計算でいきなりD=1.05などと予測され、上限を超えることがあります。これは、損傷の進展を支配する

数値解法と実装

損傷進化の数値積分と安定化

具体的に、ソフトウェアはどのようにして損傷変数を計算しているんですか? 例えば、降伏後の塑性ひずみが増えると損傷も進む、というモデルだと。

典型的な例は、Lemaitreの連続体損傷力学モデルです。塑性ひずみ増分Δε_pに基づき、損傷増分ΔDを計算します。

陽解法が問題なら、陰解法(Implicit)を使えば解決するのですか?

陰解法は一般的に安定性が高く、この問題を軽減します。なぜなら、時間ステップ終了点での状態(応力、ひずみ、損傷)を満たすように非線形方程式を反復的に解くため、増分が急激に大きくなることを内部で抑制できるからです。しかし、Ansys MechanicalやAbaqus/Standardのような陰解法ソルバーでも、材料パラメータ設定が不適切(例えば、ε_Rが小さすぎる)だと、反復計算中に損傷変数の予測値が上限を超え、発散してエラーになることがあります。

材料モデルの実装で、エラーを防ぐための特別な処理はされているのでしょうか?

はい、あります。例えば「バックトラッキング」や「サブステッピング」と呼ばれるアルゴリズムです。ある積分点でDが上限を超えると判定された場合、ソフトウェアは自動的に時間ステップを小さく分割(サブステップ化)して、その小さなステップで再計算を試みます。また、Dの増分を制限する「キャッピング」を実装しているコードもあります。LS-DYNAの一部の材料モデルでは、損傷変数の最大増分をステップあたり0.1などに制限するパラメータが存在します。

実践ガイド

エラー回避のためのモデリング手順

実際に解析を走らせてこのエラーが出た場合、最初にチェックすべきことは何ですか?

以下の順序で確認することを推奨します。

1. **材料パラメータの物理的整合性**: 特に損傷進化に関わるひずみ閾値(ε_D, ε_R)が、材料の公称応力-ひずみ曲線から求めた実際の値とかけ離れていないか。例えば、SS400鋼の破断ひずみは約20%ですが、誤って2%と入力していないか。

2. **単位系の統一**: 応力[MPa]とひずみ[無次元]は整合がとれているか。

3. **メッシュサイズ**: 局部のひずみ集中部で要素サイズが極端に小さいと、ひずみ増分が大きくなりすぎる可能性があります。

材料パラメータは実験データから引っ張ってきたので正しいはずです。それでもエラーが出る場合、解析設定で調整できる部分は?

次に、ソルバー設定を調整します。

・**陽解法の場合**: 最も影響が大きいのは「安定な時間増分」。Abaqus/Explicitでは、全体のスケーリングファクター(タイムスケールファクタ)を0.9から0.1など、より小さく減らして試みます。これにより、ステップあたりの変形量と損傷進展量が抑えられます。

・**陰解法の場合**: Abaqus/Standardなら、ステップ定義の「増分サイズ」の初期値と最小値を小さく設定します。また、「非対称マトリクスソルバー」の使用を検討します。損傷による軟化は材料の対称性を失わせるため、非対称ソルバーの方が収束しやすいことがあります。

応力-ひずみ曲線の入力で気をつける点はありますか? 例えば、降伏後の曲線を細かく定義する必要は?

非常に重要です。塑性域から破断に至るまでの応力-ひずみデータポイントが少なすぎると、ソルバーがデータポイント間を直線補間し、実際の材料挙動よりも急激な軟化(応力低下)を計算してしまうことがあります。これが局所的なひずみ集中と大きな塑性ひずみ増分を招き、損傷の急激な進展を引き起こします。JIS G 3131 SPHCのような材料でも、引張試験データからは少なくとも10〜15点、均等ではなくひずみの大きい領域でより密にデータを採取し、入力することを勧めます。

ソフトウェア比較

主要ソフトウェアにおける損傷モデルとエラー処理

このエラーへの対処法は、使うCAEソフトによって大きく違うものですか?

根本原因は同じですが、ソフトウェアごとの材料モデルの実装やエラーメッセージ、調整パラメータが異なります。

・**Abaqus**: ダメージを有効にした塑性モデル(例: Ductile Damage, Shear Damage)では、`DAMAGEC`や`DAMAGESHR`などの状態変数が出力されます。エラーメッセージは「THE DAMAGE VARIABLE HAS EXCEEDED ITS LIMIT」のようにはっきり出ます。対処法として、`*DAMAGE EVOLUTION`で`POWER=1`(線形進化)から`POWER`を大きくして進化曲線を調整する方法があります。

・**Ansys Mechanical**: 同様のモデルは「Bilinear Isotropic Hardening」に「Damage」を追加する形です。エラー時には「Material Model Failure」に関する警告が出ることが多い。ソルバー制御で「Line Search」を有効にしたり、「Newton-Raphson Option」を調整したりします。

COMSOLやLS-DYNAのような別のソフトではどうでしょうか?

・**COMSOL Multiphysics**: 「非線形構造材料」モジュールで損傷モデルを定義できます。COMSOLの特徴は、ユーザーが損傷進化の微分方程式を比較的自由に定義できる点です。そのため、方程式自体に制約条件(D ≤ 0.999)を組み込むことも可能です。エラーが出た場合、「分離型ソルバー」の設定で、従属変数(ここでは損傷変数)のスケーリングファクターを調整する手法が有効なことがあります。

・**LS-DYNA**: 材料モデル(MAT_024など)に損傷パラメータ(FAIL)が組み込まれています。エラー処理は非常に実務的で、要素が破棄される(デフォルトでは有効ひずみがFAIL値に達した時)と、その要素の応力が即座にゼロになります。計算が破綻しにくい反面、エネルギー保存などの観点で注意が必要です。

無料・オープンソースのソルバー(CalculiX, Code_Aster)では、この問題はより顕著ですか?

商用ソフトに比べて、自動的な安定化アルゴリズム(サブステッピングやバックトラッキング)の実装がシンプルである場合が多く、ユーザー自身がパラメータ設定により注意を払う必要があります。例えば、**Code_Aster**では損傷力学モデル(`ELAS_DAMA`)を使用する際、時間ステップ管理コマンド(`INCREMENT`)で`PAS_MINI`(最小ステップ)を十分小さく設定する、あるいは`NEWTON`反復法の反復回数を増やす(`ITER_INTE_MAXI`)などの手動調整がほぼ必須です。逆に言えば、数値計算の基礎を学ぶ教材としては優れています。

トラブルシューティング

エラー発生時の系統的対策

エラーが出た後、結果ファイルを確認して問題の場所を特定する方法は?

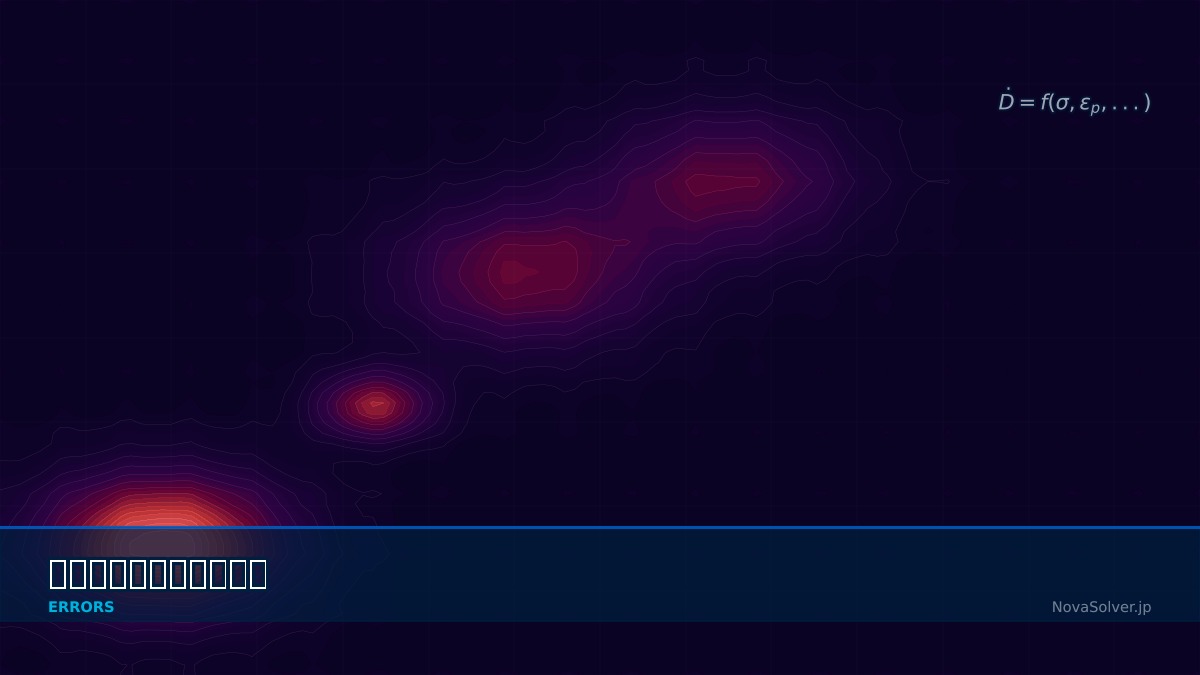

まず、エラーメッセージに記載されている「要素番号」と「積分点」を特定します。その後、その時点(または直前の収束したステップ)の結果を可視化します。確認すべき状態変数は:

1. **等效塑性ひずみ(PEEQ)**: 局所的に極端に大きな値(例えば2.0以上)になっていないか。

2. **損傷変数(DAMAGECなど)**: 問題の要素で既に0.9など高い値に達しているか。

3. **応力三軸度(Stress Triaxiality)**: 引張りで高い正の値(例: 0.5以上)だと損傷が加速されやすい。

Abaqusなら「Probe Values」、Ansysなら「Chart」機能で、問題の要素におけるこれらの変数の時系列変化をグラフ化すると、どの変数が急激に上昇しているかが一目瞭然です。

問題の場所がメッシュのエッジや角など、応力特異点だった場合はどう対処すればいいですか?

応力特異点は損傷解析の「鬼門」です。ここでの高ひずみは物理的な破壊ではなく数値的な発散なので、以下の対策を講じます。

1. **局所的なメッシュ粗化**: 特異点周辺の要素サイズをわざと大きくし、ひずみ集中を鈍化させる。ただし、大局的な応力分布への影響を評価する必要あり。

2. **フィレットの追加**: 設計変更が許されるのであれば、鋭利な角にフィレット(面取り)を追加し、特異点を除去するのが最善。

3. **損傷開始ひずみの調整**: その材料モデルでのみ、特異点を含む要素群に対して、損傷開始ひずみε_Dを物理的にあり得ないほど大きな値(例: 0.5)に設定し、実質的に損傷が進まないようにする。これは最後の手段です。

全て試してもダメな場合、損傷モデルを使うのを諦めるべきですか?

必ずしもそうではありません。最終手段として、よりシンプルで安定な破壊判定基準に切り替える方法があります。

・**塑性ひずみ基準**: 等效塑性ひずみがある値(ε_failure)に達した要素を破棄する。多くのFEMコードで安定に動作します。

・**応力基準または変位基準**: 局部の応力や変位が閾値を超えた時点で「破壊」とみなす。

これらの方法は連続体損傷力学に基づくエネルギー散逸の評価はできませんが、破壊開始位置や大まかな荷重-変位曲線の予測には有用です。目的に応じて、モデルの複雑さと安定性のトレードオフを考えることがエンジニアの判断です。

関連トピック

なった

詳しく

報告