ML自适应网格细化

理论与物理

概述

老师!今天要讲的是ML自适应网格细化的内容对吧?具体是什么样的技术呢?

这是一种利用误差估计值或解的梯度模式,通过ML预测需要细化的区域的方法。它在降低后验误差估计计算成本的同时,实现了高效的h型细化。

啊,原来如此!误差估计值和解的梯度原来是这样的机制啊。

控制方程

用数学公式表示的话是这样的。

嗯…只看公式还是不太明白…这个式子表示的是什么意思呢?

ML预测模型:

理论基础

“理论基础”这个词我倒是听说过,但可能并没有真正理解…

ML自适应网格细化是旨在融合数据驱动方法与基于物理建模的重要技术。在传统的CAE分析中,计算成本是一个巨大的瓶颈,而引入ML自适应网格细化可以大幅改善计算效率与预测精度之间的权衡。本方法的数学基础立足于函数逼近理论和统计学习理论,其泛化性能的保证和收敛性的严格分析是理论研究的课题。特别是在输入维度较高时,应对“维度灾难”是实用化的关键,降维和稀疏性的利用是重要的方法。

我明白前辈说的“自适应网格细化一定要认真做”的意思了。

数学定式化的细节

接下来是“数学定式化的细节”!这部分是什么内容呢?

展示将机器学习模型应用于CAE时的基本数学框架。

损失函数的构成

损失函数的构成,具体是指什么呢?

在AI×CAE中,损失函数被构成为数据驱动项和物理约束项的加权和:

其中 $\mathcal{L}_{\text{data}}$ 是与观测数据的平方误差,$\mathcal{L}_{\text{physics}}$ 是控制方程的残差,$\mathcal{L}_{\text{reg}}$ 是正则化项。权重参数 $\lambda$ 的调整对学习的稳定性和精度有很大影响。

泛化性能与外推问题

请给我讲讲“泛化性能与外推问题”!

代理模型最大的挑战在于学习数据范围外(外推区域)的预测精度。虽然通过融入物理定律可以改善外推性能,但要完全保证是很困难的。

维度灾难

请给我讲讲“维度灾难”!

当输入参数空间的维度较高时,所需的样本数量会呈指数级增长。通过主动学习或拉丁超立方采样进行高效的样本配置非常重要。

假设条件与适用极限

这个公式不是万能的吗?在什么情况下不能用呢?

- 学习数据需充分代表分析对象的物理现象

- 输入参数与输出的关系需是光滑的(存在不连续时需要进行区域分割)

- 主要目的是降低计算成本,对于需要高精度的最终验证应结合使用传统求解器

- 若学习数据质量不足(未进行网格收敛、未进行V&V),模型的可靠性会下降

啊,原来如此!学习数据代表分析对象原来是这样的机制啊。

无量纲参数与主导尺度

老师,请给我讲讲“无量纲参数与主导尺度”!

理解支配分析对象物理现象的无量纲参数,是进行适当模型选择和参数设定的基础。

- 佩克莱数 Pe: 对流与扩散的相对重要性。Pe >> 1 时为对流主导(需要稳定化方法)

- 雷诺数 Re: 惯性力与粘性力之比。流体问题的基本参数

- 毕渥数 Bi: 内部传导与表面对流之比。Bi < 0.1 时可应用集总热容法

- 库朗数 CFL: 数值稳定性的指标。显式解法中需要 CFL ≤ 1

啊,原来如此!分析对象的物理现象原来是这样的机制啊。

量纲分析验证

请给我讲讲“量纲分析验证”!

对于分析结果的数量级估计,基于白金汉Π定理的量纲分析非常有效。使用特征长度 $L$、特征速度 $U$、特征时间 $T = L/U$,可以事先估计各物理量的数量级,从而确认分析结果的合理性。

原来如此。那么只要能够分析对象的物理现象,首先就没问题了对吗?

边界条件的分类与数学特征

选择合适的边界条件直接关系到解的唯一性和物理合理性。边界条件不足会导致不适定问题,而边界条件过多则会产生矛盾。

嗯,状态不错嘛!实际动手操作是最好的学习方式。有不明白的地方随时可以问我。

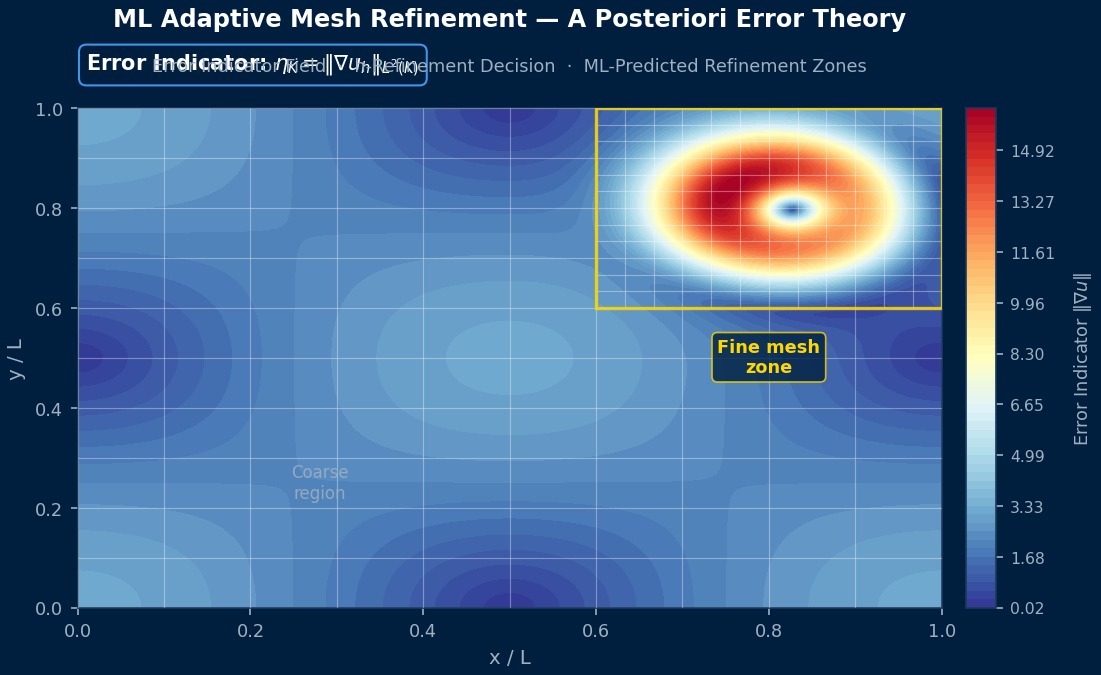

自适应网格细化的理论——后验误差估计器与ML的区分使用

自适应网格细化(AMR:Adaptive Mesh Refinement)的理论基础是有限元分析中的“后验误差估计器(a posteriori error estimator)”。Zienkiewicz-Zhu(ZZ)估计器是其代表,它在分析后计算相邻单元间的应力不连续性,并将其作为不连续性较大(即解较粗糙)区域需要细化的指标。这种方法在理论上可以保证误差的上限,但缺点是需要先进行一次分析再进行细化,导致计算成本翻倍。ML的用武之地就在这里,它作为在分析前仅根据CAD形状预测“该区域可能需要细化”的“先验(a priori)估计器”,可以在一开始就生成合适的网格,通过一次分析达到收敛。结合先验与后验的混合策略在实际应用中最为强大。

各项的物理意义

- 守恒量的时间变化项:表示目标物理量随时间的变化率。在稳态问题中为零。【形象比喻】给浴缸放热水时,水位随时间上升——这个“单位时间内的变化速度”就是时间变化项。关闭阀门后水位保持恒定的状态就是“稳态”,此时时间变化项为零。

- 通量项(流束项):描述物理量的空间输运与扩散。主要分为对流和扩散两种。【形象比喻】对流就像“河流的流动带动小船移动”那样,物体随流动被输送。扩散就像“墨水在静止的水中自然扩散”那样,物体因浓度差而移动。这两种输运机制的竞争支配着许多物理现象。

- 源项(生成/消失项):表示物理量局部生成或消失的外力/反应项。【形象比喻】在房间里打开暖气,该处就会“生成”热能。化学反应中燃料被消耗,质量就会“消失”。这是表示从外部注入系统的物理量的项。

假设条件与适用极限

- 连续介质假设成立的空间尺度

- 材料/流体的本构关系(应力-应变关系、牛顿流体定律等)在适用范围内

- 边界条件在物理上合理且在数学上正确定义

量纲分析与单位制

| 变量 | SI单位 | 注意点·换算备忘 |

|---|---|---|

| 特征长度 $L$ | m | 需与CAD模型的单位制保持一致 |

| 特征时间 $t$ | s | 瞬态分析的时间步长需考虑CFL条件·物理时间常数 |

数值解法与实现

数值手法的细节

具体是用什么算法来求解ML自适应网格细化的呢?

讲解实现ML自适应网格细化时的数值方法与算法。

原来如此…自适应网格细化看起来简单,实际上内涵非常深奥啊。

离散化与计算步骤

这个方程,在计算机上实际是怎么求解的呢?

作为数据预处理,输入特征量的归一化/标准化非常重要。由于CAE数据中不同物理量的尺度差异很大,需要适当选择最小-最大归一化或Z-score标准化。在选择学习算法时,需要根据数据量、维数、非线性程度选择合适的算法。

实现上的注意点

在实际工作中使用ML自适应网格细化时,最需要注意的是什么?

通常利用Python生态系统(scikit-learn, PyTorch, TensorFlow)进行实现。通过GPU并行化加速学习、自动调整超参数、交叉验证防止过拟合是实现的关键。对于大规模CAE数据的高效I/O处理,推荐使用HDF5格式。

验证手法

老师,请给我讲讲“验证手法”!

根据目的区分使用k折交叉验证、留一法、留出法,并使用决定系数R²、RMSE、MAE、最大误差等多方面评估预测性能,这非常重要。

我明白前辈说的“交叉验证一定要认真做”的意思了。

代码质量与可复现性

在实际工作中使用ML自适应网格细化时,最需要注意的是什么?

通过版本管理(Git)、自动测试(pytest)、CI/CD流水线的引入,确保代码质量和实验的可复现性。彻底执行依赖库版本固定(requirements.txt),使计算环境易于重建。通过固定随机数种子确保结果的可复现性也是重要的实现惯例。

啊,原来如此!版本管理原来是这样的机制啊。

实现算法的细节

相关主题

なった

詳しく

報告